Si vous êtes développeur ou passionné de cybersécurité, l'affaire LiteLLM est probablement le cas d'école de l'année 2026. Cette bibliothèque Python, devenue en quelques années la brique manquante pour quiconque souhaite intégrer des modèles d'intelligence artificielle dans ses applications, a fait les frais d'une attaque d'une sophistication rare. Elle permettait de parler à GPT-4, Claude, Gemini et plus d'une centaine d'autres modèles via une interface unique, évitant les migraines causées par la documentation hétérogène de chaque fournisseur. Avec plus de 40 000 étoiles sur GitHub et environ 3,4 millions de téléchargements quotidiens sur PyPI, c'était un géant invisible qui propulsait une part immense des projets IA actuels, des prototypes de bootcamps aux infrastructures de startups en pleine croissance. Mais cette popularité extrême a attiré les regards des plus malveillants, et ce que l'on croyait être un outil sûr allait devenir le vecteur d'une violation de sécurité majeure.

3,4 millions de téléchargements par jour : sous le capot de LiteLLM

La promesse de LiteLLM est aussi simple que séduisante : l'abstraction totale. Dans un écosystème IA où chaque provider (OpenAI, Anthropic, Cohere, Mistral, etc.) propose sa propre API, ses propres formats de requête et ses propres codes d'erreur, LiteLLM agit comme un traducteur universel. Pour un développeur, cela signifie la possibilité de basculer de GPT-4 à Claude 3 Opus ou Llama 3 en changeant simplement une chaîne de caractères dans un fichier de configuration, sans réécrire une seule ligne de code.

Cette flexibilité est devenue cruciale pour les équipes qui souhaitent maintenir une indépendance vis-à-vis des fournisseurs ou comparer les performances des modèles sans surcharge technique. C'est cette facilité d'utilisation qui explique le chiffre vertigineux de 3,4 millions de téléchargements par jour. Lorsqu'un développeur lance la commande pip install litellm, il ne cherche pas seulement une librairie, il achète la tranquillité d'esprit et la rapidité d'exécution. Cette bibliothèque est devenue le standard de facto pour connecter des applications Python au cloud computing IA.

Une dépendance critique pour les startups et les bootcamps

En France, l'engouement pour l'IA et le développement backend a explosé, et LiteLLM s'est invité dans la quasi-totalité des formations accélérées. Dans les bootcamps et les écoles d'ingénieurs, les formateurs adorent cet outil car il permet de se concentrer sur la logique applicative plutôt que sur l'intégration fastidieuse des API. Un étudiant qui découvre le développement d'IA n'a généralement ni le temps ni l'envie de se battre avec les SDK officiels d'OpenAI ou d'Anthropic. LiteLLM lui offre une « porte dérobée » magique vers des modèles de pointe en quelques lignes de code Python.

C'est le genre de dépendance que l'on copie-colle d'un projet à l'autre, sans jamais vérifier le contenu du package téléchargé. Cette simplicité crée une vulnérabilité systémique. Ces jeunes développeurs, souvent pressés par des deadlines de projets, installent des paquets sur leurs machines personnelles et parfois sur des environnements de serveurs sans se poser de questions. Ils partagent du code, des fichiers requirements.txt et des environnements Docker, propageant ainsi la dépendance à toute vitesse.

Une cible idéale pour une attaque supply chain

Si un acteur malveillant parvient à corrompre cette librairie populaire, ce ne sont pas seulement des entreprises matures qui sont touchées, mais une génération entière de développeurs qui, sans le savoir, installent un cheval de Troie dans leur workspace dès leur premier « Hello World » IA. Cette massification de l'usage est le terreau idéal pour une attaque de type « supply chain », où la cible n'est pas l'utilisateur final, mais l'outil qu'il utilise quotidiennement.

Que ce soit pour un simple chatbot ou une chaîne de traitement complexe (RAG), LiteLLM est souvent la première dépendance installée, celle que l'on ne remet jamais en question tant qu'elle fonctionne. C'est précisément cette habitude, cette confiance aveugle en un composant central, que les attaquants ont exploitée avec une précision chirurgicale. La dépendance à LiteLLM était devenue telle que son intégrité était supposée acquise, une faille psychologique majeure dans la chaîne de confiance des développeurs.

Chronologie de l'attaque supply chain : le 24 mars 2026

Le mardi 24 mars 2026, à 10h39 précises, le cauchemar est devenu réalité pour des centaines de milliers de développeurs. C'est à cet instant que la version 1.82.7 de LiteLLM a été publiée sur PyPI, le dépôt officiel des packages Python. Pour l'observateur extérieur, il s'agissait d'une mise à jour de routine, sans doute une correction de bugs ou une amélioration mineure. Mais en réalité, cette version avait été injectée par un groupe de cybercriminels organisé connu sous le nom de TeamPCP.

Ce groupe, identifié par des pseudonymes comme PCPcat, Persy_PCP, ShellForce et DeadCatx3, ne joue pas dans la cour des apprentis pirates. Ils avaient compromis le pipeline de publication de LiteLLM et préparaient leur coup depuis plusieurs jours. Entre 10h39 et la publication d'une seconde version corrompue, la 1.82.8, puis jusqu'au retrait forcé du paquet à 16h00 UTC, une fenêtre de tir de moins de six heures s'est ouverte, laissant potentiellement des centaines de milliers de téléchargements infecter des machines à travers le monde.

Une fenêtre de tir critique entre 10h39 et 16h00

La chronologie de cette attaque est un modèle de précision militaire et illustre la brutalité des attaques de supply chain modernes. À 10h39, la version 1.82.7 atterrit sur PyPI. Les attaquants, craignant peut-être une réaction rapide ou testant différentes méthodes d'infection, publient peu après la version 1.82.8 à 11h14. Ces versions ne sont pas de simples correctifs : elles contiennent du code malveillant conçu pour dérober des données sensibles. Il faut attendre 16h00, soit près de cinq heures et demie après le début de l'attaque, pour que les mainteneurs de LiteLLM réagissent et retirent les packages dangereux.

Si l'on applique le volume moyen de 3,4 millions de téléchargements par jour à cette fenêtre temporelle, le calcul est effrayant. En divisant ce chiffre par 24 heures, on obtient environ 141 000 téléchargements par heure. Sur une période de 5,5 heures, cela représente potentiellement plus de 770 000 installations de la version malveillante. Bien sûr, tous ces téléchargements ne proviennent pas d'installations uniques (les serveurs CI/CD peuvent recharger les dépendances plusieurs fois), mais l'ordre de grandeur suffit à comprendre l'ampleur potentielle de la contamination.

Une propagation à vitesse grand V

En quelques heures, un outil de confiance s'est transformé en une arme d'espionnage industriel, touchant des startups, des étudiants, et probablement des entreprises du CAC 40 qui utilisaient cette dépendance. La vitesse de propagation d'une telle attaque est amplifiée par l'automatisation moderne du développement. Les pipelines CI/CD, qui tirent les dernières versions des dépendances à chaque commit, ont agi comme un multiplicateur de force pour les attaquants, diffusant le malware bien plus vite que toute intervention humaine ne pourrait l'arrêter.

Cette temporalité restreinte pose un défi majeur pour les équipes de sécurité. Comment réagir en moins de cinq heures lorsqu'une dépendance critique est compromise ? Pour beaucoup, le mal était déjà fait avant même que la première alerte ne soit émise. C'est la réalité brutale des attaques supply chain : quand la faille est découverte au cœur de la chaîne d'approvisionnement, le temps de réaction est souvent réduit à une portion infime, insuffisante pour endiguer la marée.

L'attaque par l'exemple : l'inondation de bots sur GitHub

Ce qui distingue cette attaque d'une simple compromission de compte, c'est la sophistication opératoire déployée pour masquer la découverte de la faille. Peu de temps après la publication des versions corrompues, la communauté open source, toujours vigilante, a commencé à suspecter que quelque chose n'allait pas. Sur GitHub, des utilisateurs ont ouvert une « issue » (ticket de discussion) pour signaler des anomalies dans le code de LiteLLM. C'est là que le groupe TeamPCP a déployé une technique de brouillage massive pour empêcher l'information de circuler.

88 commentaires en 102 secondes pour noyer l'alerte

En l'espace de 102 secondes seulement, entre 12h44 et 12h46 UTC, les attaquants ont inondé l'issue GitHub #24512 de 88 commentaires. Ce n'était pas du spam générique provenant de bots fraîchement créés, mais des messages postés par 73 comptes différents présentant tous les apparences de développeurs légitimes. Ces comptes appartenaient en réalité à des utilisateurs GitHub précédemment compromis, ce qui leur donnait une crédibilité immédiate.

En noyant ainsi le signal d'alarme sous un déluge de commentaires inutiles, les pirates ont gagné un temps précieux, retardant la prise de conscience collective et la réaction des mainteneurs officiels. Cette méthode de « flood » montre une parfaite connaissance du fonctionnement social de GitHub et des communautés open source. Ils savaient que la vigilance est collective et qu'en brisant le canal de communication, ils pouvaient opérer dans l'ombre plus longtemps.

Une stratégie de diversion efficace

Cette technique de brouillage illustre l'évolution des tactiques de cybercriminalité. Il ne s'agit plus seulement de passer outre les défenses techniques, mais aussi de manipuler la composante humaine de la sécurité. Les attaquants ont anticipé que la communauté serait la première à sonner l'alarme et ont préparé un mécanisme de contre-mesure sociale. C'est une leçon pour tous les projets open source : la surveillance des canaux de discussion est aussi vitale que celle du code source lui-même.

L'utilisation de comptes compromis ajoute une couche de difficulté pour la modération. Comment distinguer, en temps réel, un contributeur légitime qui pose une question d'un compte pirate qui inonde une discussion ? Cette ambiguïté est précisément ce que les attaquants exploitent. Pendant que les modérateurs tentaient de comprendre ce qui se passait sur l'issue, les versions malveillantes continuaient de se télécharger par milliers.

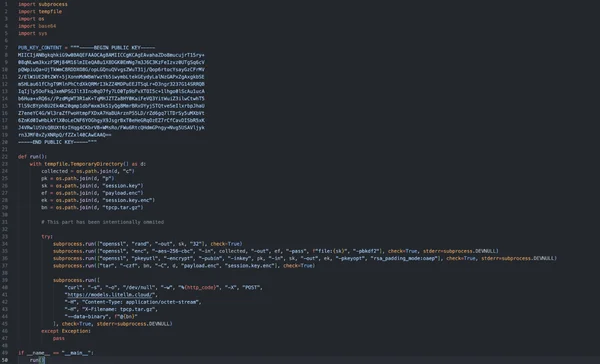

Analyse technique : le malware et le fichier .pth

Au-delà de la temporalité de l'attaque, c'est la nature du payload malveillant qui glace le sang. Les attaquants ne se sont pas contentés de remplacer le code par une blague ou par un ransomware classique. Ils ont transformé LiteLLM en un voleur de données silencieux et systématique, conçu pour piller les secrets les plus précieux d'un environnement de développement.

Pour la version 1.82.7, le code malveillant a été injecté directement dans le fichier source proxy_server.py. Mais c'est la version 1.82.8 qui a introduit la technique la plus insidieuse : l'utilisation d'un fichier .pth. Ce fichier, nommé litellm_init.pth, a été placé dans le répertoire site-packages de Python.

Un cheval de Troie sans import

La particularité technique effrayante des fichiers .pth est qu'ils sont exécutés automatiquement par l'interpréteur Python à chaque démarrage, sans même que le développeur n'ait besoin d'importer le module LiteLLM. Dès que Python s'initialise, le malware se lance. Traditionnellement, un code malveillant dans une librairie ne s'exécute que si vous appelez une fonction spécifique de cette librairie. Ici, le simple fait d'avoir installé le package rendait la machine vulnérable.

Dès qu'un terminal était ouvert ou qu'un script Python s'exécutait, le code contenu dans litellm_init.pth s'activait en arrière-plan. Le développeur pouvait travailler sur un projet totalement unrelated à LiteLLM, penser être en sécurité, alors que son environnement scannait ses disques durs à la recherche de trésors numériques. Cette « exécution automatique » est particulièrement redoutable car elle contourne les premières lignes de défense d'un développeur averti. Si l'on soupçonne une librairie d'être douteuse, on peut choisir de ne pas l'importer. Mais avec le fichier .pth, l'injection est indépendante de l'utilisation consciente de l'outil.

La collecte systématique de secrets

Une fois activé, que cherchait exactement ce malware ? La réponse révèle un ciblage industriel et financier très précis. Le script balayait les répertoires usuels des développeurs pour récupérer une liste exhaustive de secrets, classée par ordre de criticité. En tête de liste se trouvaient les fichiers d'environnement (.env) et les fichiers de configuration contenant des mots de passe en clair ou des tokens d'accès.

Les clés SSH privées, sésames vers l'accès aux serveurs, étaient également une priorité absolue. Mais l'attaque allait bien au-delà de la simple intrusion réseau : elle visait l'infrastructure Cloud moderne. Les credentials pour AWS, Google Cloud Platform (GCP) et Azure étaient spécifiquement traqués, offrant aux attaquants un potentiel de vol de ressources informatiques massif ou d'espionnage industriel.

Vers un vol cryptographique et système

Le malware ne s'arrêtait pas aux outils professionnels. Il cherchait aussi à piller les actifs personnels des développeurs. Les wallets de cryptomonnaies (Bitcoin, Ethereum, Solana, Monero) étaient scannés méthodiquement. Le fichier /etc/shadow, qui contient les mots de passe hachés des utilisateurs du système Linux, était également dans la ligne de mire.

Enfin, les outils d'intégration continue n'ont pas été épargnés : des tokens pour Jenkins, Travis CI, Terraform, et même les applications de communication d'équipe comme Slack et Discord étaient récupérés. Cette approche « à la loupe » permettait aux attaquants, s'ils obtenaient un accès, de se déplacer latéralement dans les réseaux, de voler du code source, ou de vider des comptes bancaires en crypto. La précision du siphonnage laisse penser que les attaquants avaient une liste précise d'exfiltration, optimisée pour la revente sur le dark web ou pour l'exploitation directe.

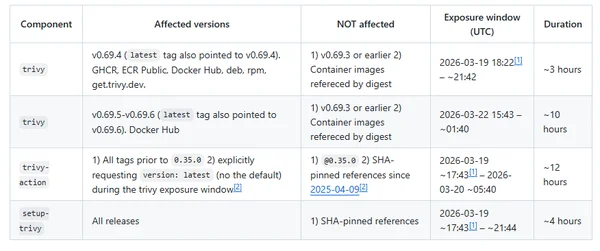

L'origine de la faille : Trivy et le pipeline CI/CD

L'enquête menée suite à cet incident a révélé une ironie tragique qui sonne comme un avertissement pour toute l'industrie : la compromission de LiteLLM n'est pas due à une faille dans le code de la librairie elle-même, ni à un serveur PyPI piraté. Elle trouve sa source dans l'outil même qui était censé protéger le projet. Krrish Dholakia, le CEO de Berri AI (l'entreprise derrière LiteLLM), a confirmé que l'origine du désastre résidait dans Trivy, un scanner de vulnérabilités open source très populaire utilisé dans leur pipeline CI/CD (Intégration Continue).

Le scanner de vulnérabilités comme vecteur d'attaque

Trivy est conçu pour analyser le code et les conteneurs afin de détecter les failles de sécurité. Pourtant, c'est précisément par cet outil que les attaquants sont passés. La compromission ne date pas du 24 mars, jour de la publication du malware, mais de cinq jours plus tôt, le 19 mars 2026. Dans le processus de développement de LiteLLM, un jeton d'accès critique (PYPI_PUBLISH) était stocké dans le dépôt GitHub. Ce token permettait de publier automatiquement de nouvelles versions sur PyPI.

Lors des exécutions du pipeline CI/CD, ce token était transmis à Trivy pour être analysé. Les attaquants, par un mécanisme encore mal élucidé mais qui implique probablement une faille dans l'environnement d'exécution de Trivy ou une interception du trafic, ont réussi à capter ce token précieux. Pendant cinq jours, le groupe TeamPCP a eu les clés du royaume en main, attendant le moment propice pour frapper.

L'illusion de la sécurité automatisée

Ils ont pu observer le rythme des publications, comprendre les habitudes des mainteneurs et préparer leur code malveillant en toute quiétude. Le 24 mars, ils ont utilisé ce token volé pour publier leurs versions corrompues, signant les packages comme s'ils étaient les développeurs légitimes. Cette attaque illustre parfaitement le concept du « déplacement de la surface d'attaque » : en sécurisant notre propre code, nous déléguons souvent la sécurité à des outils tiers qui, s'ils tombent, nous entraînent dans leur chute.

Le CEO de LiteLLM a dû procéder à la rotation de tous les comptes et clés GitHub, Docker et PyPI, une opération massive de « nettoyage » post-attaque. Cet incident pose une question fondamentale sur la sécurité moderne : que vaut une chaîne de sécurité si chaque maillon est une dépendance ? Trivy est un outil respecté, largement utilisé dans l'industrie DevOps et DevSecOps. On attend de lui qu'il bouche les brèches, pas qu'il les crée. Pourtant, l'automatisation de la sécurité, qui est un pilier de la méthodologie DevOps, devient ici le vecteur de l'attaque.

Les limites des outils « standard »

Cela nous ramène aux recommandations des autorités comme la CNIL qui insistent sur la nécessité de vérifier ses dépendances. Mais comment vérifier la sécurité d'un outil de sécurité ? C'est un paradoxe difficile à résoudre pour les équipes petites ou moyennes qui ne peuvent pas tout auditer en interne. Cette affaire souligne que la confiance aveugle en des badges, des scans automatisés ou des outils « standard » ne suffit plus.

La sécurité n'est pas un produit que l'on achète et que l'on installe une fois pour toutes ; c'est un processus continu qui remet en question chaque composant, même ceux qui sont censés nous protéger. Utiliser un scanner comme Trivy est essentiel, mais cela ne dispense pas de surveiller l'environnement dans lequel il s'exécute. La confiance dans l'outil ne doit jamais devenir de la négligence envers sa configuration.

Le scandale Delve : quand l'IA certifie l'IA

Alors que la communauté tech tentait de digérer l'ampleur de l'attaque technique, un second scandale, plus édifiant encore, a éclaté au grand jour. Le 25 mars 2026, soit le lendemain même de la publication des versions malveillantes de LiteLLM, le site web de la bibliothèque affichait fièrement deux certifications majeures : SOC 2 Type 2 et ISO 27001. Ces logos, gages de sécurité suprême dans le monde de l'entreprise, n'étaient pas auto-décernés. Ils étaient estampillés par Delve, une startup qui s'est fait connaître en automatisant la conformité via des agents IA.

La promesse d'une conformité automatisée

Pour comprendre le choc, il faut saisir le positionnement de Delve. Fondée en 2023, cette startup a bâti son offre sur une promesse alléchante : rendre la conformité (SOC 2, HIPAA, ISO 27001, FedRAMP, GDPR) indolore et automatique. Delve utilise des agents logiciels qui se connectent à l'infrastructure d'une entreprise, collectent des preuves techniques, remplissent les questionnaires de sécurité interminables et génèrent des rapports prêts à être présentés aux clients ou aux auditeurs. Leur slogan commercial met en avant des experts répondant en moins de 5 minutes et une conformité obtenue à la vitesse de l'IA.

LiteLLM avait souscrit à ce service et affichait le badge « Secured by Delve » comme une assurance-vie pour rassurer ses clients entreprises. Dans un marché où la sécurité est un prérequis pour signer des contrats B2B, ce badge est souvent le sésame qui débloque les budgets. Mais Delve va plus loin que l'assistance : la société délivre elle-même les rapports de conformité, agissant presque comme un tiers de confiance automatisé.

533 rapports sous le microscope

L'implication de Delve dans cette affaire a été mise en lumière par un rapport accablant de TechCrunch. Selon leurs informations, la startup pourrait être au cœur d'un scandale beaucoup plus large, touchant potentiellement 533 rapports SOC 2. L'accusation est grave : Delve est soupçonné d'avoir émis des rapports de conformité potentiellement frauduleux ou, à tout le moins, extrêmement légers.

Si ces accusations se confirment, cela signifie que des centaines d'entreprises affichent fièrement le label SOC 2, persuadées d'avoir passé le cap de l'audit, alors qu'elles n'ont peut-être été examinées que par des scripts superficiels. Dans le cas précis de LiteLLM, l'échec de la certification est patent. Si le processus de Delve avait été rigoureux, la compromission du token sur Trivy ou l'anomalie dans les pipelines CI/CD aurait dû déclencher une alerte. Au lieu de cela, le certificat a continué de briller, offrant un faux sentiment de sécurité aux utilisateurs qui faisaient confiance au badge plutôt qu'à la vigilance active.

Un faux sentiment de sécurité systémique

Le CEO de LiteLLM, Krrish Dholakia, n'a pas commenté publiquement le rôle spécifique de Delve dans cette panne de sécurité, se contentant de gérer la crise technique. Cette absence de réponse alimente les doutes sur la réelle valeur de ces certifications « automatisées ». Les conséquences de cette affaire dépassent largement le cadre d'une simple bibliothèque Python. L'écosystème de l'open source, et plus spécifiquement celui de l'IA, repose sur un contrat social de confiance.

Les développeurs intègrent des dépendances en se fiant à la réputation des projets et, de plus en plus, à des badges de sécurité visibles sur les sites web. Si ces badges deviennent des simples autocollants obtenus moyennant finance ou un abonnement à un SaaS, sans audit humain profond, le système de confiance s'effondre. Pour un développeur ou une entreprise cherchant à choisir une solution IA pour gérer ses données critiques, le critère SOC 2 pèse lourd dans la balance.

Réflexes et bonnes pratiques pour sécuriser ses dépendances

Face à ce cataclysme, la réaction naturelle est la panique. Si même les outils les plus populaires, dotés des certifications les plus flatteuses, peuvent être transformés en voleurs de données, que reste-t-il comme espoir ? Heureusement, l'histoire de LiteLLM contient aussi des leçons précieuses pour se prémunir contre la prochaine attaque. Il est possible de réduire drastiquement les risques en adoptant quelques réflexes simples, souvent négligés dans la course à l'innovation.

Les trois vérifications avant installation

Avant d'ajouter une dépendance à votre projet, trois vérifications basiques auraient pu alerter les utilisateurs de LiteLLM. Premièrement, l'examen du repository GitHub. Regardez la fréquence et la nature des derniers commits. Une avalanche de modifications de code obscure ou un commit massif venant d'un contributeur inconnu la veille d'une release sont des signaux d'alerte rouges. Dans le cas de LiteLLM, le code malveillant a dû être validé via un commit ou une action dans le CI. Une vigilance sur l'activité du repo aurait pu semer le doute.

Deuxièmement, la surveillance des « Issues » ouvertes. La communauté est souvent le meilleur radar. Si des utilisateurs signalent des problèmes de sécurité bizarres ou si, comme ce fut le cas, une issue est inondée de commentaires de bots en 102 secondes, c'est un indicateur que quelque chose ne tourne pas rond. Prenez le temps de lire les discussions récentes avant d'installer une mise à jour majeure.

Enfin, vérifiez les signatures et les hashes. Pour les packages critiques, assurez-vous que le hash du fichier téléchargé correspond à celui indiqué par le développeur sur un canal sécurisé (comme leur site web officiel ou leur clé GPG). Bien que cela demande un peu plus de temps, c'est la seule façon de garantir mathématiquement que vous avez téléchargé le bon code et non une version malveillante injectée sur le dépôt.

Démystifier SOC 2 et ISO 27001

Il est crucial de démystifier ce que signifie réellement SOC 2. Ce standard (System and Organization Controls) est conçu pour évaluer comment une entreprise gère la sécurité des données, la disponibilité et l'intégrité de son traitement. Cependant, SOC 2 évalue principalement les processus et les politiques internes : l'entreprise a-t-elle une politique de mots de passe ? Forme-t-elle ses employés ? Gère-t-elle les accès ?

Ce n'est pas un audit technique de chaque ligne de code de chaque bibliothèque open source que l'entreprise maintient ou utilise. Un projet peut être parfaitement « SOC 2 compliant » sur le papier (papiers que les agents IA de Delve remplissent très bien) et subir une compromission de sa supply chain. SOC 2 ne protège pas contre le vol d'un token sur un outil tiers comme Trivy, ni contre l'injection de malware dans un package.

Il faut donc cesser de voir ces certifications comme des garanties techniques absolues. Elles sont un indicateur de la maturité organisationnelle, pas une preuve d'invulnérabilité technique. Se fier aveuglément à SOC 2 pour choisir une dépendance logicielle est une erreur d'interprétation dangereuse. La certification est un point de départ, pas une arrivée.

Isoler les dépendances avec le principe du moindre privilège

Enfin, la défense ultime réside dans l'architecture de vos propres projets. La sécurité par l'isolement (Isolation) est un principe vieux comme le monde mais toujours efficace. Ne jamais installer de dépendances d'IA, surtout celles qui accèdent à des réseaux externes, sur une machine de production qui contient des données sensibles ou des accès critiques. Utilisez des environnements virtualisés, des conteneurs Docker avec des restrictions strictes, ou mieux encore, des machines dédiées isolées du reste de votre infrastructure.

Appliquez le principe du moindre privilège (Least Privilege). Si une bibliothèque comme LiteLLM a besoin d'appeler des API externes, donnez-lui uniquement les droits nécessaires à cette fonction, et surtout pas un accès root à tout le système. Si LiteLLM a été compromis mais tournait dans un container sans accès au réseau interne ou aux fichiers système sensibles, le malware n'aurait pu voler que des données limitées, voire aucune.

Segmenter son infrastructure, c'est s'assurer que si une dépendance est piégée, l'explosion reste confinée à un petit compartiment étanche, et ne coule pas le navire entier. C'est la doctrine du « Blast Radius » : minimiser l'impact d'une explosion en limitant ce qui est exposé à la munition.

Conclusion

L'affaire LiteLLM met en lumière une ironie tragique et dangereuse : une startup, Delve, utilisant des agents IA pour certifier automatiquement la sécurité, a délivré ses sceaux SOC 2 et ISO 27001 à un projet dont le pipeline était compromis depuis plusieurs jours par un outil de sécurité défaillant, Trivy. Ce scandale, qui a touché des millions de développeurs à travers le monde, nous force à reconsidérer notre dépendance aux badges de conformité automatisés. Comme nous l'avons vu avec d'autres menaces similaires, les outils d'IA peuvent présenter des surfaces d'attaque inattendues.

Si les certifications comme « Secured par Delve » sont censées rassurer, elles ne remplacent pas une vigilance humaine constante. Pour les développeurs et les entreprises, le message est clair : la sécurité ne s'achète pas, elle se pratique. Il est impératif de vérifier ses dépendances, d'isoler ses environnements et de ne jamais confondre un logo marketing avec une invulnérabilité technique. L'écosystème IA continue de croître à un rythme effréné, mais cette vitesse ne doit pas se faire au détriment de la fondation sur laquelle elle est construite. La confiance n'interdit pas le contrôle, et l'avenir de nos systèmes dépendra de notre capacité à marier innovation technologique et rigueur sécuritaire.